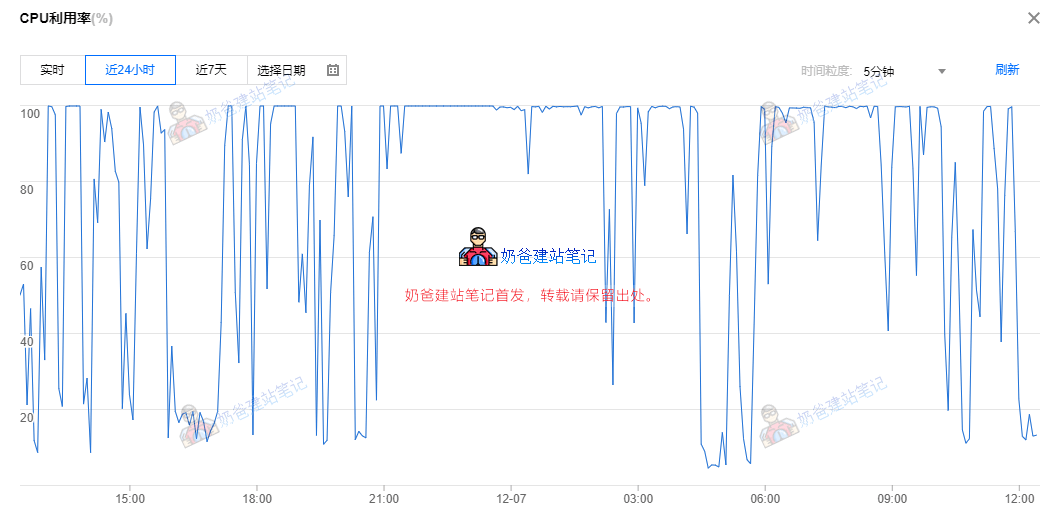

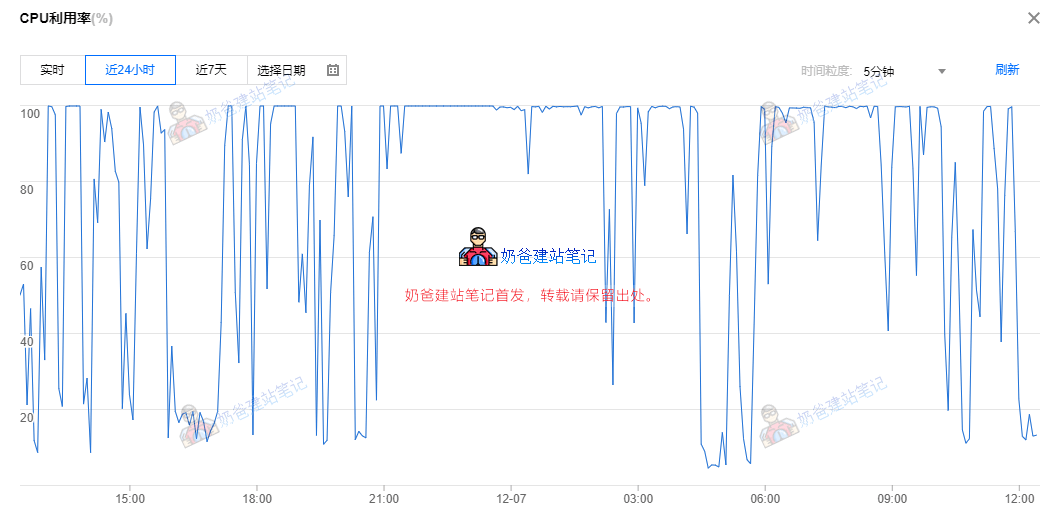

ウェブサイトのトラフィックが明らかに増加していない状況で、ウェブサイトサーバーが非常に重いと感じた場合、どこか問題が発生していないか検討する必要があります。通常、ウェブサイトがアップグレードや技術的な変更を行っていない場合、問題は外部に発生することが多く、例えばウェブサイトがクロールされたり、検索エンジンによって過剰にクロールされたりすることがあります。 Naibaは最近サーバーの監視情報を確認したところ、サーバーのCPU使用率が非常に高いことがわかりました。以下の図をご覧ください:

ウェブサイトのログを分析した結果、Bingのボットによるクロールが頻繁すぎることが判明したため、これを解決する必要があります。

解決策は、Bingのクロール頻度を制限することです。。

方法1:管理者ダッシュボードで設定

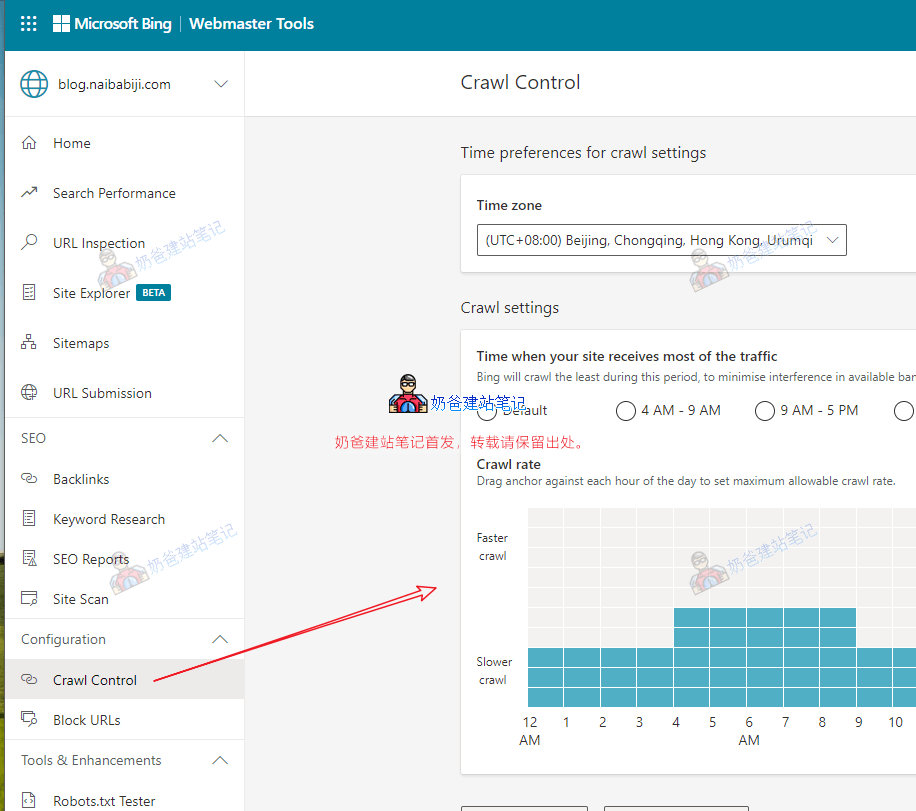

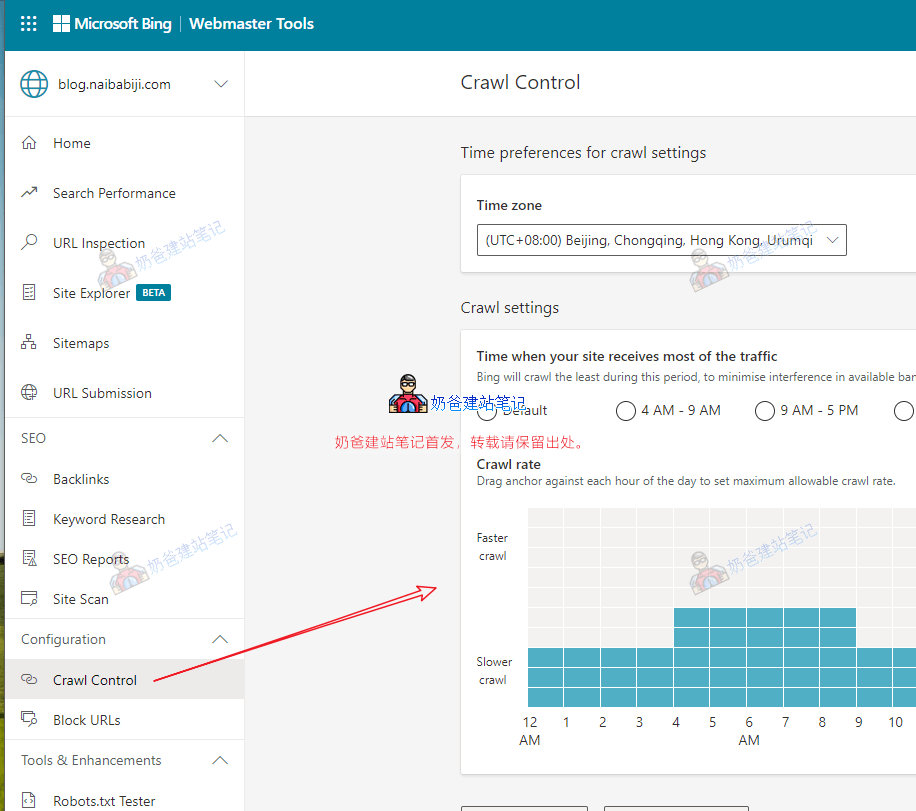

Bing Webmasterツールに登録済みの場合、ダッシュボードでCrawl Controlメニューを見つけ、右側でクロール頻度を設定できます。

方法2:robots.txtファイルで設定

robots.txtが何かわからない場合は、まずこちらをお読みください:

robots.txtとは_WordPressの正しいrobotsの書き方と生成ツールrobots.txtにcrawl-delayというパラメータを追加することができます。

User-agent: *

Crawl-delay: 1

上記のコードは、すべての検索エンジンに対してクロール頻度を「遅い」に制限することを意味します。 Crawl-delayを設定しない場合、クロール頻度は検索エンジンが独自に決定します。 この値は1、5、10に設定でき、それぞれ「遅い」、「非常に遅い」、「極めて遅い」に対応します。

Googleや百度などの他の検索エンジンの場合も、それぞれのウェブマスターツールでクロール頻度を設定できますし、robots.txtファイルで設定することもできます。比較すると、robots.txtの方が効果が現れるまでに時間がかかることがあります。 ウェブサイトのログを分析した結果、Bingのボットによるクロールが頻繁すぎることが判明したため、これを解決する必要があります。解決策は、Bingのクロール頻度を制限することです。。

ウェブサイトのログを分析した結果、Bingのボットによるクロールが頻繁すぎることが判明したため、これを解決する必要があります。解決策は、Bingのクロール頻度を制限することです。。 Bing Webmasterツールに登録済みの場合、ダッシュボードでCrawl Controlメニューを見つけ、右側でクロール頻度を設定できます。

Bing Webmasterツールに登録済みの場合、ダッシュボードでCrawl Controlメニューを見つけ、右側でクロール頻度を設定できます。

コメントは終了しました

この記事のコメント機能は終了しています。ご質問がある場合は、他の方法でお問い合わせください。